PEFT

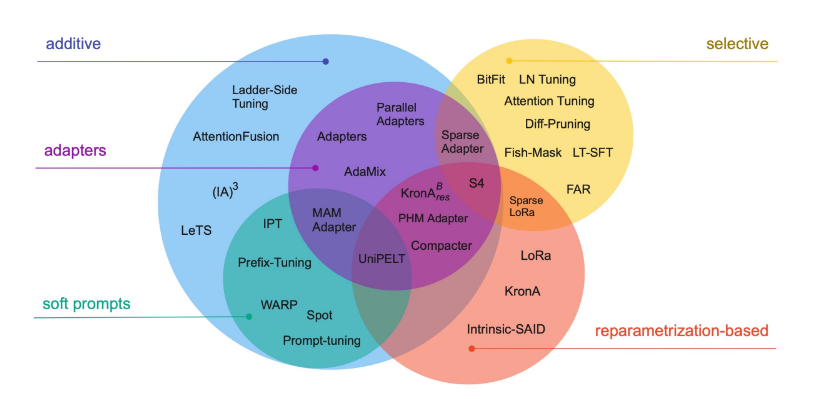

이미지 출처: Scaling Down to Scale Up: A Guide to Parameter-Efficient Fine-Tuning

Adapter Fine-Tuning¶

Adapter Fine-Tuning은 사전 훈련된 대규모 언어 모델(LLM)에서 전체 모델의 매개변수를 업데이트하지 않고, 적은 수의 추가 매개변수만 학습하는 파라미터 효율적인 전이 학습(Parameter-Efficient Transfer Learning, PETL) 방법입니다. 2019년에 제시되어 사전훈련된 언어 모델의 전이 학습의 효과적인 방법론으로 제시되었습니다. Houlsby et al. (2019)

이 기법은 작업별로 필요한 추가 정보를 처리하면서도 기존 모델의 구조와 가중치를 최대한 보존합니다.

전이 학습은 사전 훈련된 모델을 기반으로 특정 작업에 맞게 재조정하는 방법으로, 자연어 처리(NLP) 분야에서 중요한 발전을 이끌어왔습니다. 기존 연구에 따르면, 사전 훈련된 모델을 활용한 전이 학습은 텍스트 분류, 질문 응답 등 다양한 작업에서 뛰어난 성능을 보여줍니다. Howard & Ruder (2018)Radford et al. (2018) 특히, BERT와 같은 Transformer 기반 모델은 대규모 데이터셋으로 비지도 학습을 통해 사전 훈련되었고, 이를 기반으로 다운스트림 작업에서 최첨단 성능을 달성했습니다 Devlin et al. (2019).

기존 전이 학습의 한계와 문제점¶

사전 훈련된 모델을 활용한 전이 학습은 자연어 처리(NLP) 분야에서 중요한 기술로 자리 잡았습니다. 특징 기반 전이 학습(Feature-based Transfer)과 미세 조정(Fine-Tuning)은 각각 독창적인 강점을 가지고 있지만, 두 방법 모두 작업별로 새로운 매개변수 세트를 학습해야 한다는 공통적인 한계를 가지고 있습니다.

특히 Fine-Tuning은 네트워크의 모든 매개변수를 업데이트하므로 작업당 전체 모델 크기만큼 추가 메모리가 필요합니다. 이는 작업 수가 많아질수록 저장 공간과 계산 비용이 급격히 증가하게 됩니다. 특징 기반 전이 학습은 주로 단어나 문장의 임베딩을 생성하여 커스텀 모델에 입력으로 제공하지만, 이 또한 성능 면에서 한계를 보입니다.

어댑터 기반 전이 학습의 개념¶

어댑터 기반 전이 학습(Adapter Tuning)은 사전 훈련된 모델의 기존 구조를 유지하면서, 새로운 작업에 필요한 소량의 추가 파라미터만 학습하는 접근법입니다. 어댑터 모듈(Adapter Module)은 모델의 각 계층에 삽입되며, 다음과 같은 과정을 통해 작업에 특화된 정보를 학습합니다.

입력 데이터를 낮은 차원으로 변환(Down-Projection)하여 연산량을 줄임.

비선형 활성화 함수를 사용해 복잡한 표현을 학습.

변환된 데이터를 원래 차원으로 복원(Up-Projection)하여 모델 출력에 통합.

Skip Connection을 통해 원래 모델의 출력과 결합하여 정보 손실을 최소화.

기존 접근법과의 비교¶

특징 기반 전이 학습

단어나 문장 수준의 임베딩을 학습하고 이를 커스텀 모델에 입력으로 사용하는 방식으로, 다양한 작업에 활용 가능합니다. 하지만 이 접근법은 새로운 작업에 맞게 별도의 모델을 설계해야 하며, 성능이 제한적일 수 있습니다.미세조정(Fine-Tuning)

사전 훈련된 모델의 가중치를 복사한 후, 작업별로 모든 매개변수를 재조정하는 방식입니다. Fine-Tuning은 특징 기반 전이 학습보다 더 높은 성능을 제공하지만, 작업별로 모든 가중치를 저장해야 하므로 메모리 사용량이 늘어납니다.어댑터 기반 전이 학습

기존 Fine-Tuning의 단점을 해결하며, 다음과 같은 이점을 제공합니다:기존 모델의 구조와 가중치를 유지하고, 추가 학습되는 파라미터만 저장.

작업 간 높은 파라미터 효율성으로 새로운 작업을 처리.

기존 작업의 성능을 유지하면서 새로운 작업을 점진적으로 학습.

어댑터 기반 접근법은 작업당 학습해야 할 파라미터의 수를 미세조정 대비 100배 규모로 감소시킵니다. 이러한 특성은 제한된 리소스 환경에서도 전이 학습을 실용적으로 적용할 수 있도록 만듭니다.

파라미터 효율성

전체 모델의 매개변수를 업데이트하지 않아, 적은 학습 가능 파라미터로 특정 작업에 맞춘 조정이 가능합니다.모델 공유 용이

작업별 어댑터만 별도로 저장 및 공유 가능하여 재사용성을 극대화합니다.메모리 효율성

학습 중 메모리 사용량이 크게 줄어 자원이 제한된 환경에서 효과적입니다.다중 작업 학습

동일한 사전 훈련된 모델에 여러 작업용 어댑터를 삽입하여 병렬 학습이 가능합니다.

Adapter Fine-Tuning은 대규모 언어 모델에서 파라미터 효율성과 재사용성을 극대화하는 혁신적인 방법입니다. 학습 가능한 매개변수를 최소화하면서도 특정 작업에 대한 뛰어난 성능을 유지할 수 있어, 특히 자원이 제한된 환경에서 주목받고 있습니다. 이는 전이 학습의 새로운 가능성을 열며, NLP, 컴퓨터 비전 등 다양한 분야에서 빠르게 채택되고 있습니다.

- Houlsby, N., Giurgiu, A., Jastrzebski, S., Morrone, B., de Laroussilhe, Q., Gesmundo, A., Attariyan, M., & Gelly, S. (2019). Parameter-Efficient Transfer Learning for NLP. https://arxiv.org/abs/1902.00751

- Howard, J., & Ruder, S. (2018). Universal Language Model Fine-tuning for Text Classification. https://arxiv.org/abs/1801.06146

- Radford, A., Narasimhan, K., Salimans, T., & Sutskever, I. (2018). Improving language understanding by generative pre-training. https://cdn.openai.com/research-covers/language-unsupervised/language_understanding_paper.pdf

- Devlin, J., Chang, M.-W., Lee, K., & Toutanova, K. (2019). BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding. https://arxiv.org/abs/1810.04805